Shaping your workforce

Talogy helps organizations worldwide to hire, identify, and develop the right people with effective talent assessment and development solutions.

Chosen by the world’s top employers

How Talogy supports your talent strategy

People are the heartbeat of any organization.

By partnering with you to fully understand your organizational challenges, we can gather the data you need to strengthen your talent management strategy and help you make the best people decisions.

End-to-end solutions

Our end-to-end talent management solutions combine online assessments with in-person consulting services to help you establish complete hiring and development processes. Talogy InView Leadership and Talogy Spotlight are our latest talent solutions – offering customized assessment and development packages for leadership and early career talent.

Talent assessments

Understand candidate fit so you can accurately select the right talent for roles at all levels with Talogy’s market-leading assessment portfolio. With multiple reporting options, a wide range of languages, flexible branding opportunities, and different types of assessment solutions and tools available, you can choose an exact fit for your talent assessment and development objectives.

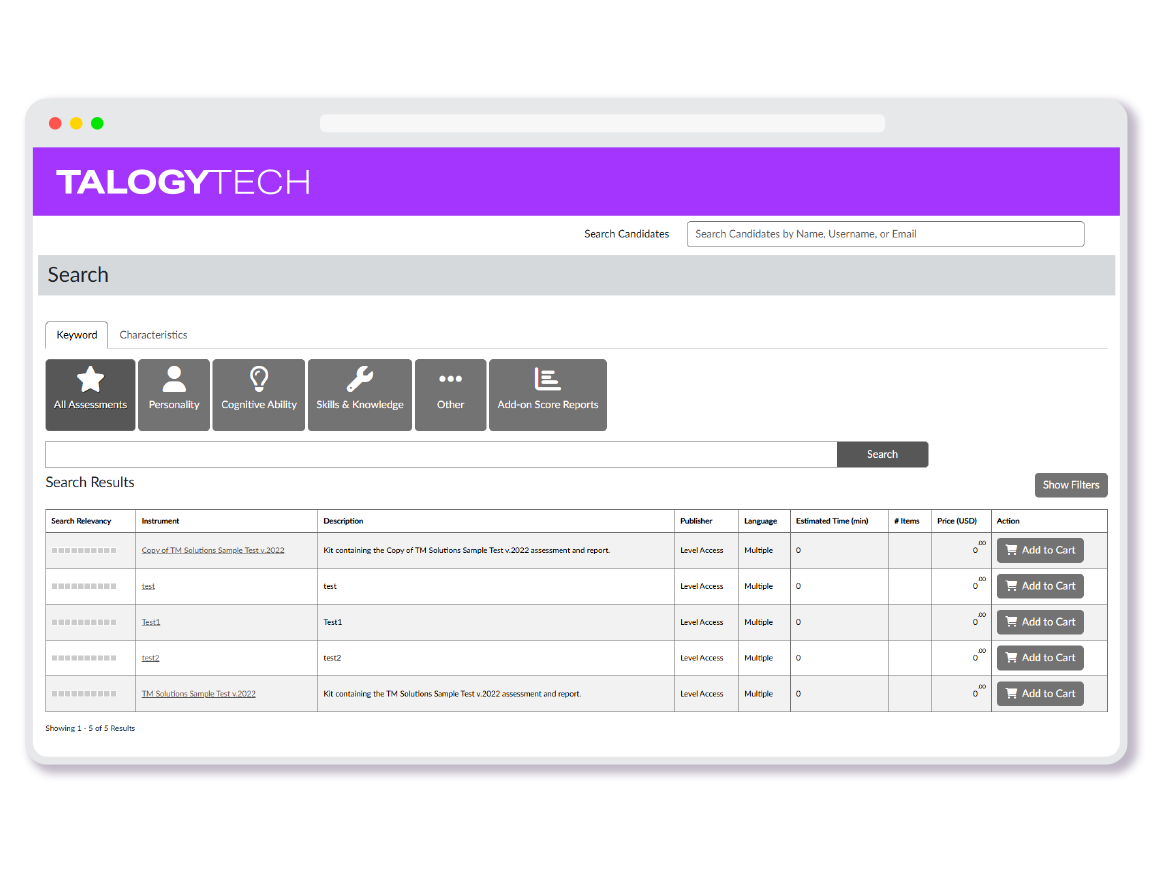

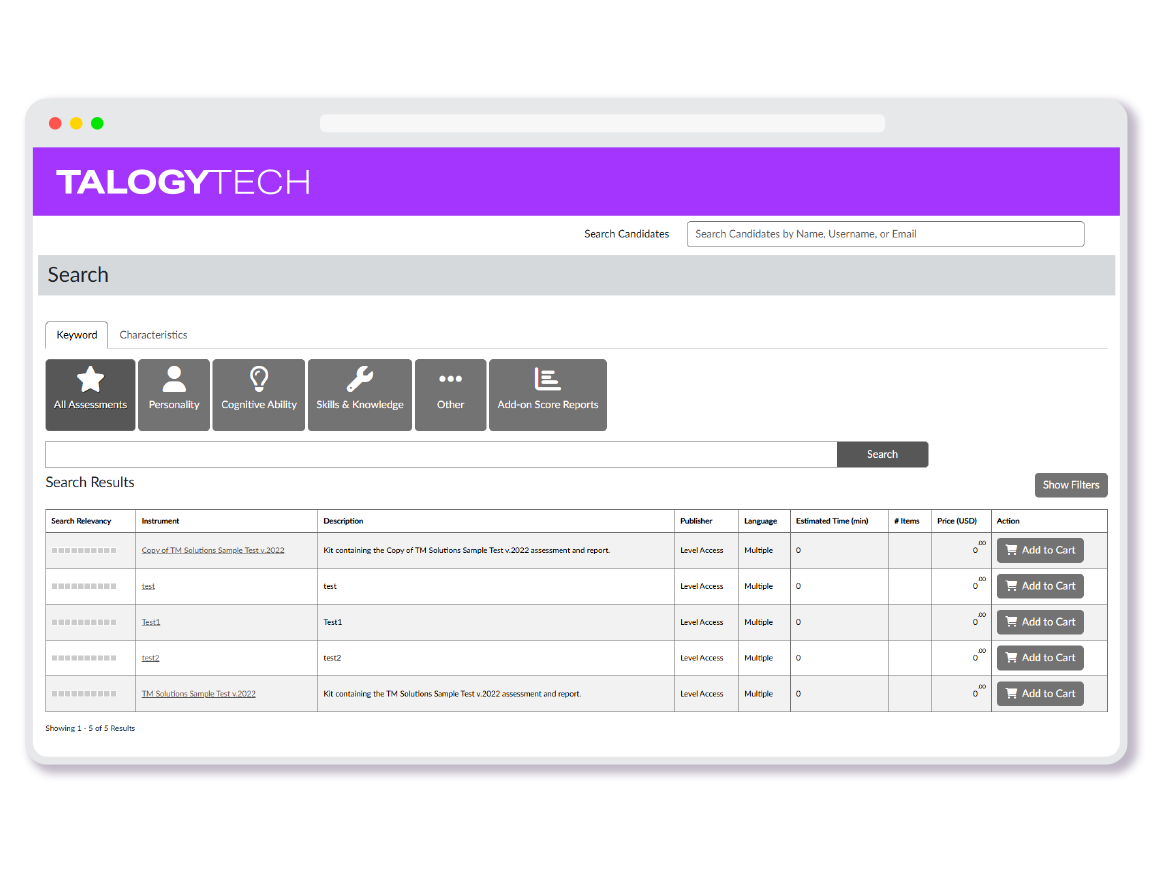

Assessment technology

TalogyTech is our online assessment platform. Integrating effortlessly with your ATS, it delivers a seamless experience for HR users and candidates. With an enhanced user experience, easily customizable interface, and dynamic reporting options, you get the flexibility to create assessment processes specific to your needs.

Consulting services

For the in-person touch, our global team of consulting experts are always on hand to deliver effective solutions for different stages of the talent life cycle and different levels of your organization.

Our services include coaching solutions, leadership and executive assessments, assessment centers, development centers and much more. Whether you need light-touch support or a deeper collaboration, think of us as partners for your talent management strategy.

Why Talogy?

People first – every time.

All our solutions, assessments, science, and technology are rooted in understanding people and their potential in the workplace. We help you make the best people decisions to ensure your talent strategy succeeds.

- 75+ years of experience and expertise

- 150+ in-house psychologists and psychometricians worldwide

- Trusted by 10,000+ organizations around the world

- Delivering talent solutions in 160 countries

We are impressed with Talogy’s commitment to working together. They design and deliver solutions that have a lasting impact on both people and the business. They understand people and provide professional, data-based, and useful advice.

Get the latest talent insights from Talogy

Resources to support your talent management strategy.

Where do you need our expertise?

See where our people expertise and talent-focused technologies can help your organization grow stronger.

HR Excellence Awards

Association for Business Psychology Awards

Recruitment Industry Disability Initiative Awards

Your talent is in safe hands with Talogy

Data security

Talogy takes data security seriously. We ensure safe and compliant processes everywhere in our operations with measures including:

- Security and Privacy Incident Response Policy aligned to ISO27001 and NIST SP800-53 standards

- Commitment to compliance with the General Data Protection Regulation 2016/679 (“GDPR”)

- Data is encrypted both when stored (through TDE) and when it is being transmitted (through TLS 1.2)

Read more about Talogy security measures in our legal notices.

Accessibility

Talogy is committed to providing online services that are equal for all.

The current standard used by Talogy is the World Wide Web Consortium’s Web Content Accessibility Guidelines 2.1 at Levels A and AA (“WCAG 2.1”).

Secure systems integration

Streamline your candidate processes, create efficiency, and consolidate your analytics and reporting by integrating TalogyTech – our online talent solutions platform – with your HR systems.

ATS integration is a seamless, secure process that makes a positive impact on your talent management strategy. Workday, Taleo, Oracle, Success Factors, ICIMS, and Kenexa are among the leading ATS providers our team has integrated with previously.

Global support

Our global support team is here to help with any queries. The team is also on standby 24/7, ready to resolve issues and provide expert assistance in real time, across any region or time zone, as part of our premium support service.

In-house technology and research

Our technology is developed, built, and maintained in-house by Talogy’s technology group. All data and research are owned by Talogy R&D, we don’t outsource. We own what we do, so you can trust our commitment to your needs.

Want to strengthen your talent management strategy? Ask Talogy.

We’re here to help with your talent strategy. Talogy’s talent assessment and development solutions are designed to support your organizational goals— and your people. Reach out today.